2025年,視頻生成領域迎來爆發式發展。OpenAI的Sora、Google DeepMind的Veo 3以及Runway的Gen-4等模型相繼問世,其生成的視頻片段已達到以假亂真的程度,甚至被應用于Netflix劇集《永恒族》的視覺特效制作中。這些技術突破標志著AI視頻生成從實驗室走向實際應用,但同時也引發了關于內容質量、能源消耗和倫理問題的廣泛討論。

當前,AI視頻生成技術已不再局限于專業領域。隨著Sora和Veo 3通過ChatGPT、Gemini等應用向付費用戶開放,普通影視愛好者也能輕松創作高質量視頻內容。然而,這種技術普及也帶來了負面影響:社交媒體上充斥著大量低質量AI生成內容,虛假新聞片段的傳播速度遠超人工核實能力。更嚴峻的是,視頻生成的能源消耗是文本或圖像生成的數十倍,其環境成本引發擔憂。

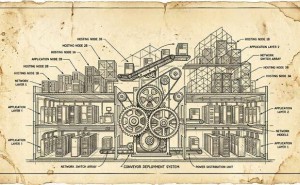

技術層面,最新一代視頻生成模型采用"潛在擴散Transformer"架構。這一名稱雖復雜,但可拆解為三個核心組件:擴散模型、潛在空間壓縮和Transformer序列處理。擴散模型通過逆向還原隨機噪點生成圖像,其原理類似于將電視雪花屏逐步還原為清晰畫面。為提升效率,模型在"潛在空間"中操作——將視頻幀壓縮為數學編碼,僅保留關鍵特征,從而大幅減少計算量。例如,處理1080p視頻時,潛在空間技術可將數據量壓縮至原始尺寸的1/100。

保持視頻幀間一致性是另一技術挑戰。OpenAI的解決方案是將視頻在時空維度切割為"數據立方體",再由Transformer模型處理這些序列塊。這種方法使模型能理解物體運動軌跡和光照變化,避免生成視頻中出現物體突然消失或變形的問題。Sora首席研究員蒂姆·布魯克斯比喻道:"這就像同時處理一摞視頻幀的每個小方塊。"

音頻生成技術的突破尤為引人注目。Google DeepMind的Veo 3首次實現音視頻同步生成,從人物口型到背景音效均能完美匹配。其核心創新在于將音視頻數據壓縮為統一表示形式,使擴散模型能同時處理兩種模態。這種"聯合擴散"機制確保了聲音與畫面的時空對齊,例如人物說話時嘴唇動作與語音波形完全同步。DeepMind首席執行官德米斯·哈薩比斯宣稱:"我們結束了視頻生成的無聲時代。"

技術邊界正在模糊化。傳統上,擴散模型專注于多媒體生成,而大語言模型(LLM)使用Transformer架構處理文本。但近期研究顯示,用擴散模型替代Transformer構建LLM可能帶來效率革命。Google DeepMind的實驗表明,擴散型LLM在文本生成任務中能耗降低40%,同時保持輸出質量。這種架構融合趨勢預示著,未來可能出現同時處理文本、圖像、視頻和音頻的統一生成模型。