在AI領域的一場靜悄悄的技術革命中,DeepSeek公司憑借其創新的原生稀疏注意力(Native Sparse Attention, NSA)機制,正逐步成為行業的焦點。就在馬斯克高調推出新產品,而Sam Altman在開源策略上猶豫不決之時,DeepSeek悄然發布了一項可能顛覆游戲規則的新技術。

近日,DeepSeek的首席執行官在公開場合透露,由梁文鋒親自參與的研究論文成果——NSA機制,是團隊在稀疏注意力領域的突破性創新。這一機制結合了算法上的創新和硬件上的優化,旨在解決長上下文建模中的計算瓶頸問題。

根據DeepSeek的研究論文,NSA機制不僅將大語言模型處理64k長文本的速度提升了最高11.6倍,而且在通用基準測試中,其性能甚至超過了傳統的全注意力模型。在全球AI競賽日益轉向“硬核創新”的背景下,這家低調的中國公司以其獨特的技術路徑,展示了破局的新思路。

值得注意的是,盡管NSA機制尚未應用于DeepSeek V3的訓練中,但已有跡象表明,一旦將其整合到模型訓練中,基座模型的能力有望實現顯著提升。論文明確指出,使用NSA預訓練的模型已經超越了全注意力模型。

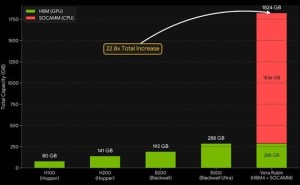

與此同時,xAI則選擇了截然不同的道路,即追求工程規模的極致。馬斯克發布的Grok3使用了20萬塊GPU集群,而未來的Grok4更是計劃使用百萬塊GPU、1.2GW的集群。這種“財大氣粗”的做法,無疑體現了北美在AI領域一貫的“大力出奇跡”風格。

然而,與xAI的“堆算力”策略相比,DeepSeek的NSA機制則顯得更為巧妙和高效。NSA機制通過動態分層稀疏策略、算術強度平衡的設計以及端到端可訓練的特性,實現了高效的長文本建模。其核心組件包括壓縮注意力、選擇注意力和滑動窗口注意力三個并行的注意力分支,通過門控機制進行聚合,從而最大化效率。

實驗結果顯示,NSA技術在多個方面都展現出了卓越表現。在通用基準測試、長文本任務和指令推理方面,使用NSA預訓練的模型性能不僅沒有下降,反而超越了全注意力模型。更重要的是,在處理64k長度的序列時,NSA在解碼、前向傳播和反向傳播等各個階段都實現了顯著的速度提升,最高可達11.6倍。

AI寒武紀的分析指出,DeepSeek的NSA技術為長文本建模帶來了新的突破。它不僅在性能上超越了傳統的全注意力模型,更在效率方面實現了顯著提升,尤其是在長序列場景下。NSA的硬件友好設計和訓推一體化特性,使其在實際應用中更具優勢,有望加速下一代大語言模型在長文本處理領域的應用落地。

DeepSeek在模型研發階段就已經開始考慮未來適配更多類型計算卡的問題。NSA機制降低了浮點算力和內存占用門檻的特性,或許暗示了DeepSeek正在為更廣泛、更普遍的開源做準備。與xAI通過超大集群在短時間內實現性能反超但投入產出比并不理想的情況相比,DeepSeek的NSA機制無疑提供了一種更為高效和可持續的發展路徑。