在拉斯維加斯舉辦的年度re:Invent盛會上,亞馬遜云科技(Amazon Web Services, AWS)震撼發布了其全面的生成式人工智能(AI)產品組合,這一系列舉措無疑將在企業級AI應用領域掀起波瀾。

生成式AI近年來在提升生產效率方面展現出了巨大潛力,迅速成為企業應用的熱門領域。然而,企業在初步嘗試這一技術后,如何確保員工在工作中持續使用,而非將其束之高閣,成為云計算巨頭們亟待解決的關鍵問題。AWS,作為這一領域的領航者,在re:Invent大會上給出了自己的答案。

AWS在大會上推出了涵蓋從底層算力芯片、模型訓練和基礎模型,到中層智能體開發,再到上層AI應用的全方位新產品。這些新產品旨在解決企業在引入生成式AI時面臨的五大核心挑戰:選擇權、部署成本、模型訓練效率、消除幻覺以及解決復雜任務的能力。

在談及企業部署生成式AI時,AWS高管強調了“豐富的選擇”對于客戶的重要性。AWS不僅自主研發了Titan和Nova系列大模型,還投資了Anthropic等頂尖大模型開發商,為開發者提供了一個多樣化的大模型選擇平臺。這一策略與微軟云和谷歌云等傾向于依賴自家或頂尖合作伙伴的策略形成鮮明對比。

AWS進一步擴展了其大模型供應庫,發布了自研大模型Amazon Nova,并與擅長視頻生成和代碼生成的大模型開發商達成合作。AWS推出了Amazon Bedrock Marketplace,提供了超過100個來自全球供應商的基礎模型產品,用戶可以在Bedrock上選擇和測試這些新模型。

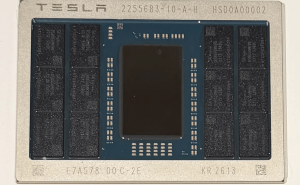

在計算成本方面,AWS正式推出了Amazon EC2 Trn2實例,相比GPU實例,性價比提升30%-40%。同時,AWS還劇透了下一代算力芯片Trainium 3,采用3nm先進制程工藝,提供兩倍于Trainium 2的算力,以及40%的單位能效提升。AWS還推出了Prompt Caching技術,旨在減少AI應用在調用大模型時的計算開銷、延遲和成本。

為了滿足企業對敏捷、專業小模型的需求,AWS在Amazon Bedrock中推出了模型蒸餾功能。這一功能使得新模型的運行速度能夠提升500%,成本降低75%,用戶只需將應用示例發給Bedrock,即可完成所有剩余工作。AWS還加強了數據治理領域的產品線,包括新型數據管理工具Amazon S3 Tables和元數據工具Amazon S3 metaData,以及與Bedrock和SageMaker等開發系統的整合。

針對大模型的幻覺問題,AWS推出了自動推理檢查功能,能夠防止因模型幻覺而導致的事實性錯誤。這一功能基于可靠的數學驗證,能夠對模型所做出的事實陳述進行準確性檢查,確保答案的準確無誤。AWS還推出了多智能體協作功能,能夠處理更復雜的工作流程,實現智能體之間的有效協作,提升工作效率。

AWS在re:Invent大會上發布的一系列新產品和技術,不僅展示了其在生成式AI領域的巨大資源投入和堅定戰略意圖,也為企業級市場的大規模部署提供了強有力的支持。這些新產品和技術將助力企業解決具體的業務需求和實際問題,推動生成式AI從早期試驗階段向產業落地轉變。